Entendiendo a Bayes

La matemática de cambiar de opinión

Por qué leer esta nota técnica

En esta nota veremos qué significa pensar de forma bayesiana, por qué el teorema de Bayes es importante y cómo se conecta con los sistemas de inteligencia artificial (IA) actuales. El objetivo no es memorizar una fórmula, sino entender la lógica de “cuándo y cuánto” cambiar de opinión ante nueva evidencia.

Una historia breve

Thomas Bayes fue un clérigo y matemático inglés del siglo XVIII. Su legado más importante es la obra póstuma An Essay towards solving a Problem in the Doctrine of Chances (1763), editada y publicada por su amigo Richard Price.

El texto aparece en un contexto intelectual dominado por el escepticismo de David Hume, quien había cuestionado la validez de la inducción: ¿cómo podemos justificar leyes generales a partir de patrones observados? ¿Por qué el futuro debería parecerse al pasado?

El trabajo de Bayes puede leerse como una respuesta probabilística a este dilema sin mencionarlo explícitamente: si observamos regularidad en la naturaleza, ¿cuál es la probabilidad de que esa regularidad continúe? Su objetivo era demostrar que podemos cuantificar racionalmente nuestra confianza en los patrones observados.

Para ilústralo, Bayes planteó el famoso experimento mental de la mesa de billar, que hoy sigue siendo una de las mejores formas de entender el aprendizaje bajo incertidumbre. En este, imagina una mesa de billar y se lanza una bola blanca que se detiene en un punto desconocido (posición W). Luego se lanzan n bolas rojas al azar. El observador solo recibe un dato (B): cuántas cayeron a la izquierda y cuántas a la derecha de W.

A partir de ahí, Bayes mostró, a partir de las observaciones, cómo inferir la distribución de probabilidad más razonable para la posición de W:

El prior o creencia inicial: antes de ver ninguna bola roja, creemos que W puede estar en cualquier punto de la mesa con igual probabilidad (distribución uniforme).

La evidencia (B): cada bola roja que cae a la izquierda o derecha nos da nueva información sobre dónde está W.

La actualización: si las primeras 10 bolas caen todas a la derecha, nuestra creencia de que W está muy a la izquierda aumenta drásticamente.

Bayes mostró que la forma racional de tratar la incertidumbre no es alcanzar certezas absolutas, sino actualizar sistemática y continuamente nuestras creencias (los priors) a medida que llegan nuevas evidencias (B, datos).

Este principio —conocido hoy como razonamiento bayesiano— es una de las ideas centrales tras muchos métodos de aprendizaje automático —machine learning— y la IA, donde los modelos ajustan sus parámetros internos a partir de sucesivas observaciones de la realidad.

Pero su importancia va mucho más allá de la tecnología: en los negocios, significa que las mejores decisiones no se toman con “corazonadas” ni con datos aislados, sino actualizando constantemente nuestras creencias iniciales con nueva información del mercado, de los clientes o de la competencia.

El teorema de Bayes no es importante por la fórmula. Es importante porque formaliza una idea muy simple y poderosa: creer algo debería ser un proceso dinámico.

Una intuición antes que la fórmula

Llego a casa y el suelo está mojado; surgen varias explicaciones —hipótesis Ai— posibles: A1) ha llovido, A2) alguien ha fregado y A3) hay una fuga. Miro por la ventana: la calle está seca, por lo tanto baja la probabilidad de lluvia. Veo una fregona en el pasillo, lo que hace subir la probabilidad de limpieza. No decido sí o no: redistribuyo confianza entre explicaciones.

Esto es el razonamiento bayesiano.

Veamos un ejemplo numérico rápido: imagina que, antes de ver nada, consideras que lo más probable es que alguien haya fregado y bastante menos probable que haya una fuga. Podríamos asignar estas probabilidades iniciales (los priors o creencias antes de mirar por la ventana):

P(fregado) = 0,6

P(lluvia) = 0,3

P(fuga) = 0,1

Ahora observas que la calle está seca. Esa observación es más compatible con “fregado” que con “lluvia”. El teorema de Bayes te da una receta para recalcular las probabilidades de cada hipótesis incorporando esa nueva evidencia de forma cuantitativa en lugar de pasar de 0 a 1 (de falso a verdadero) de golpe. Lo importante aquí no son los números exactos, sino la idea: cada nueva evidencia ajusta gradualmente tu confianza en cada explicación posible.

Un ejemplo en marketing

Una campaña digital deja de convertir de repente. Surgen varias hipótesis: A1) el precio se ha vuelto poco competitivo, A2) el público objetivo está mal segmentado y A3) la página de aterrizaje —landing— tiene un problema de usabilidad.

Revisas los datos: la tasa de clics (CTR) de los anuncios se mantiene estable, entonces baja la probabilidad de mala segmentación. Detectas que el tiempo en página cae bruscamente tras el primer scroll, por tanto sube la probabilidad de problema de usabilidad. Además, los competidores no han cambiado precios, así que baja la probabilidad del factor precio.

De nuevo, no decides de inmediato una causa única; redistribuyes confianza entre hipótesis según la evidencia disponible.

Eso es inferencia bayesiana aplicada a negocio.

Abducción y Bayes: imaginar y ponderar explicaciones

La abducción es el razonamiento que infiere la mejor explicación o hipótesis (Ai) posible para una observación sorprendente (B). De forma esquemática:

Observo un hecho sorprendente B.

Si A fuera cierto, B sería esperable.

Concluyo que A podría ser la causa de B.

Veamos un ejemplo sencillo:

El suelo está mojado (B) → si hubiese llovido (A), eso sería normal → probablemente ha llovido (A)

La abducción no demuestra A; propone una hipótesis plausible que explica bien B.

¿Qué hace Bayes? Bayes no se ocupa de inventar hipótesis nuevas, sino de evaluar cuánto creer en cada una de las hipótesis ya propuestas.

Dadas varias explicaciones posibles A1, A2, A3… para una misma observación B, el marco bayesiano calcula:

Es decir, cuánta confianza merece cada explicación (Ai) tras observar la evidencia B.

Podemos ver los dos pasos como complementarios:

La abducción genera candidatos: imagina causas plausibles (Ai) para lo que observamos (B).

Bayes compara cuantitativamente esos candidatos: asigna y actualiza grados de confianza.

En resumen, la abducción es cualitativa y Bayes ofrece una formulación probabilística de ese mismo tipo de proceso explicativo: asignar grados de confianza a hipótesis que buscan dar sentido a lo observado. En términos simples:

La abducción responde: “¿qué podría explicar esto?”

Bayes responde: “¿qué explicación es más probable ahora?”

Por eso, muchos métodos de aprendizaje automático pueden entenderse, de forma aproximada, como abducción cuantificada: el modelo genera hipótesis (implícitas en sus parámetros) y actualiza su plausibilidad según los datos.

La estructura del teorema

El teorema de Bayes se escribe así:

Lectura intuitiva: cuánto debes creer en A después de observar B (el posterior P(A|B)) depende de: a) cuánto creía antes (el prior P(A)), b) cuánto explica A la nueva evidencia (la verosimilitud P(B|A)) y c) qué tan frecuente es esa evidencia en general (P(B)). P(B) es la probabilidad total de observar B, teniendo en cuenta todas las formas en que podría ocurrir (con A y sin A).

Una versión verbal habitual es: Posterior = (verosimilitud × prior) / evidencia

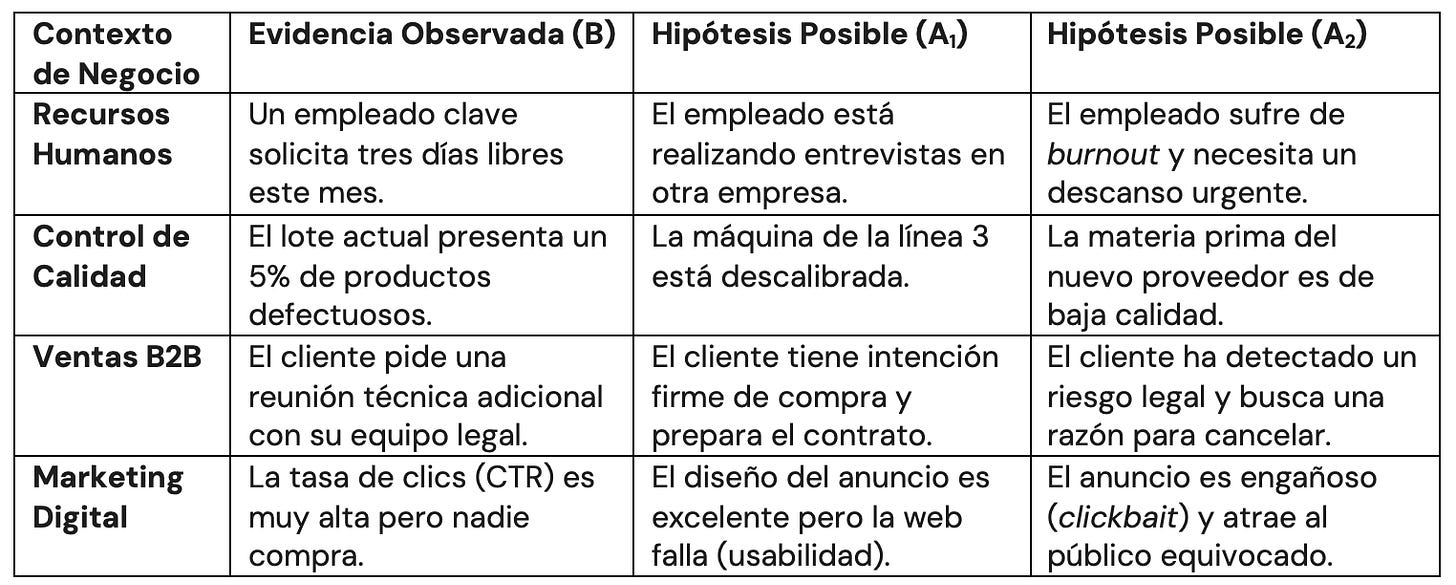

Identificando Ai y B: la multiplicidad de causas

En el razonamiento bayesiano, una sola evidencia B no suele ser concluyente porque puede responder a distintas causas Ai (hipótesis). El trabajo del directivo es redistribuir su confianza entre ellas a medida que llega nueva información.

En cada uno de estos casos de la tabla anterior, el directivo no debe saltar a una conclusión inmediata (pensamiento binario). El teorema nos obliga a preguntarnos:

Prior P(A): ¿Qué probabilidad había, antes de ver el dato, de que la máquina fallara o el cliente aceptara?

Verosimilitud P(B|A): Si fuera cierto que el cliente va a aceptar, ¿es esperable que pida una reunión legal?

Evidencia P(B): ¿Con qué frecuencia ocurren estas reuniones legales en general, incluso cuando no se acaba firmando el contrato?

Las creencias no son binarias

El teorema de Bayes nos recuerda que la racionalidad no es una dicotomía entre creer y no creer, sino un asunto de grados: cuánto peso damos a cada hipótesis. Siempre partimos de un prior, moldeado por nuestra experiencia, cultura, sesgos e información incompleta. Luego llega la evidencia; una sola evidencia rara vez cambia mucho, pero muchas evidencias acumuladas sí. Ser racional no significa acertar, significa actualizar de forma coherente el grado de confianza que damos a nuestras creencias.

Aunque el prior es el punto de partida necesario, en el ámbito directivo conlleva un riesgo: si nuestra creencia inicial es excesivamente rígida (un prior de 0 o 1), ninguna cantidad de evidencia podrá movernos de nuestra posición. Esto explica el sesgo de confirmación: la tendencia a infravalorar la verosimilitud de datos que contradicen nuestra intuición previa.

Una nota sobre la subjetividad y la convergencia

Es común cuestionar si, al depender de un prior personal, la estadística bayesiana se convierte en una simple “opinión”. La respuesta reside en la convergencia.

Aunque dos directivos partan de priors muy distintos ante el lanzamiento de un producto, si ambos son racionales y actualizan su confianza con la misma evidencia, sus opiniones tienden a converger. A medida que el volumen de datos crece, el peso de la creencia inicial se diluye frente a la fuerza de los hechos. El teorema de Bayes no valida cualquier opinión; muestra que, cuando actualizamos de forma coherente y disponemos de suficiente evidencia relevante, la fuerza de los datos tiende a imponerse sobre nuestras intuiciones previas.

Todo esto no solo afecta a cómo tomamos decisiones en la empresa, sino también a cómo discutimos en sociedad. Muchas polémicas públicas pueden leerse, en el fondo, como fallos al aplicar esta lógica de actualización bayesiana.

Por qué discutimos tanto

Muchos desacuerdos públicos no giran tanto en torno a los datos disponibles como a la forma en que actualizamos —o dejamos de actualizar— nuestras creencias a la luz de esos datos. Dos fallos típicos son:

No actualizar nunca: la evidencia se interpreta para proteger la creencia inicial.

Actualizar con un solo titular: una observación produce un cambio total.

El razonamiento bayesiano exige una disciplina de gradualidad: ni inmovilidad ante la evidencia ni volatilidad extrema ante cada dato aislado. Podríamos decir que, al estilo aristotélico, la buena racionalidad busca un término medio entre dogmatismo y cambio impulsivo.

La racionalidad probabilística

En ese espíritu, pensar racionalmente no consiste en defender una postura, sino en ajustar su peso. No vivimos entre verdadero y falso, sino entre: improbable, plausible, probable y muy probable. La calidad intelectual no se mide por la opinión actual, sino por la coherencia al modificarla.

Qué tiene que ver con la inteligencia artificial

Muchos métodos de aprendizaje automático pueden entenderse como distintas formas de actualizar creencias o parámetros a partir de datos, más o menos cercanas al ideal bayesiano. Cuando un modelo predice:

no decide, estima.

El entrenamiento funciona así:

Parámetros iniciales → prior

Datos → evidencia

Ajuste de parámetros → posterior

Repetición → convergencia aproximada

Desde esta perspectiva, el aprendizaje automático puede interpretarse como una actualización bayesiana iterada a gran escala, aunque no siempre se implemente como un modelo bayesiano explícito.

El caso de los modelos de lenguaje

Un modelo de lenguaje genera texto calculando:

No busca la verdad; maximiza coherencia estadística según regularidades lingüísticas y semánticas aprendidas de los datos con los que fue entrenado. Por eso puede acertar sin comprender, equivocarse con seguridad y sonar convincente estando equivocado. Aquí la probabilidad no mide “qué tan verdadera es una afirmación sobre el mundo”, sino qué tan coherente es como continuación de un contexto de texto dado. No razona; infiere probabilísticamente.

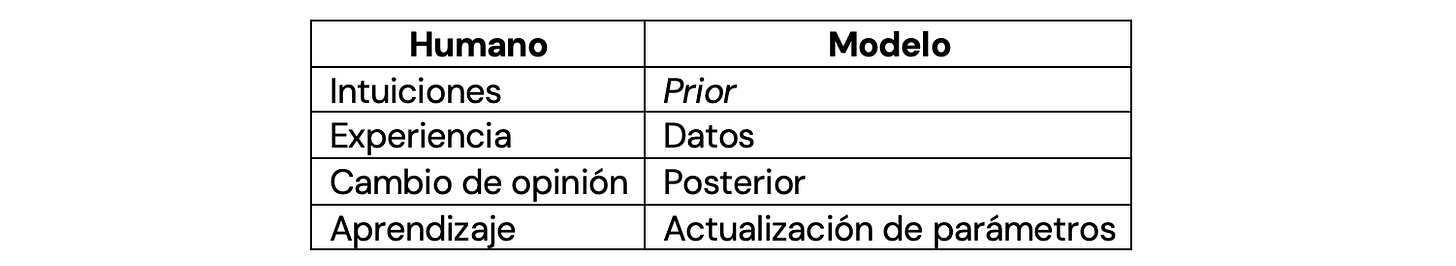

Un posible paralelismo es:

La diferencia no es el mecanismo básico, sino la disciplina de actualización.

Para directivos y analistas

Como directivo, analista o profesional de negocio, lo relevante no es tanto “tener razón” a la primera como actualizar mejor que los demás tus hipótesis a medida que entra nueva información. Pensar en términos bayesianos te obliga a hacer explícitos tus prior, a identificar qué evidencia sería realmente informativa y a ajustar tu nivel de confianza de forma gradual.

En la práctica de Business Analytics, la evidencia P(B) rara vez es gratuita. Obtener datos de calidad para actualizar nuestras hipótesis implica costes de tiempo, tecnología o experimentación. Pensar de forma bayesiana ayuda al directivo a evaluar el valor de la información: ¿merece la pena el coste de obtener este nuevo dato por el cambio que podría generar en mi nivel de confianza final?

Ejercicio mental

Piensa en una decisión reciente de negocio en la que cambiaste de opinión tras recibir nuevos datos.

¿Cuál era tu prior inicial? ¿Era una creencia flexible o estaba anclada en un sesgo de confirmación difícil de mover?

¿Qué evidencia apareció después? ¿Fue un dato fortuito o invertiste recursos (tiempo, dinero) de forma deliberada para obtener esa evidencia?

¿Cómo actualizaste tu creencia? ¿Fuiste capaz de “redistribuir confianza” o te resististe a la evidencia inicial?

¿Habría sido deseable una actualización más gradual o más rápida? En retrospectiva, ¿valió la pena el coste de obtener la información frente al cambio que produjo en tu decisión final?

Este tipo de preguntas entrenan la disciplina de actualización que el teorema de Bayes formaliza.

Conclusión

El teorema de Bayes no enseña a tener razón, sino algo más exigente: cuándo y cuánto debes cambiar de opinión. Explica cómo debería pensar una mente racional y ayuda a entender por qué funcionan los sistemas de IA actuales tal como lo hacen. Al final, la inteligencia —humana o artificial— no consiste en defender creencias, sino en reajustarlas sistemática y continuamente frente a la evidencia disponible.